La inteligencia artificial alcanza enorme notoriedad por Premios Nobel de Física y Química: ¿Cuáles son algunos beneficios y riesgos para la sociedad y la ciencia?

Martín Aluja1 y Erick Enciso Ortíz

En días recientes nos enteramos sobre quienes fueron galardonados con los muy prestigiados Premios Nobel 2024 ya que todos los medios escritos y electrónicos, así como televisivos, reportaron en sus portadas o noticiarios sobre esta noticia de alto impacto. En este artículo nos enfocaremos en dos, por sus importantes implicaciones para la sociedad y el quehacer científico: los Premios Nobel de Física (otorgado a Geoffrey Hinton y John Hopfield) y Química (otorgado a David Baker, John M. Jumper, Demis Hassabis).

Llamó la atención en muchos sectores de la sociedad y gremios académicos, el estrecho vínculo de los premiados con la Inteligencia Artificial (IA de ahora en adelante), interpretándose que las/los integrantes del comité de premiación, estaban enviando un mensaje sobre la importancia que la IA está adquiriendo, y alertando a su vez sobre sus riesgos. En todos los casos se trata de investigadores que jugaron un papel fundamental en el desarrollo de la IA, y en el caso particular de los galardonados con el premio de química, sus investigaciones tienen implicaciones potenciales asombrosas en la generación de nuevos fármacos y en general en la potencial cura de muchas enfermedades. Lo anterior, porque estos investigadores utilizaron la herramienta de la IA para predecir/diseñar nuevas estructuras muy complejas de proteínas y en general, para comprender mucho mejor la estructura y funcionamiento de las mismas (https://www.nobelprize.org/prizes/chemistry/2024/press-release/; https://www.nobelprize.org/prizes/physics/2024/press-release/). El más joven de los premiados (¡tiene solo 48 años!), Demis Hassabi, ya era muy famoso porque fundó en colaboración con Shane Legg y Mustafa Suleyman en 2010 la innovadora empresa DeepMind, que fue de las primeras empresas “start-up” que enfocaron sus baterías en el desarrollo y uso de la IA (https://aimagazine.com/articles/demis-hassabis-from-chess-prodigy-to-ai-leader; https://www.ucl.ac.uk/news/2018/sep/new-deepmind-professorship-ucl-push-frontiers-ai). En esta empresa colaboró cercanamente con otro de los premiados, John Jumper.

Entre la alegría comprensible de los premiados, llamó la atención que uno de ellos (Geoffrey Hinton) al ser entrevistado pocas horas después de recibir el extraordinario reconocimiento, hizo un llamado de alerta sobre los potenciales riesgos que representaría la aplicación de la IA sin regulación alguna o “fuera de control” (reportaje de Jannis Brühl, Theresa Palm y Marienne Weiss, periódico “Tages Anzeiger”, 09.10.2024). De la misma manera, el mismo Denis Hassabis y el creador de ChatGPT (Sam Altman) ya habían alertado sobre los riesgos de la IA (BBC News Mundo, 30.05.2023; https://www.thewrap.com/ai-leaders-warn-artificial-intelligence-safety-threat/). Porque el debate en esta materia se centra entre quienes piensan que la IA debe ser vista como una simple herramienta no peligrosa, y quienes alertan sobre el riesgo del uso sin control/restricción de esta poderosa tecnología. Por ejemplo, hace pocos meses se generó gran alarma/pánico porque un sistema (“The AI Scientist”) desarrollado por la empresa japonesa Sakana AI, logró reprogramarse solo, dándole la vuelta a las limitaciones que sus programadores habían diseñado (https://www.semana.com/tecnologia/articulo/alerta-en-la-comunidad-cientifica-inteligencia-artificial-se-reprogramo-para-eludir-control-humano/202425/).

En el caso de los premiados en el ámbito de la física, todo surgió de su interés por comprender las complejas redes neuronales en cerebros de organismos complejos (entre ellos los humanos), desarrollando después de muchos años de arduo y creativo trabajo, complejísimas redes artificiales que en muchos casos ya se asemejan a algunas existentes en nuestro cerebro (https://www.science.org/content/article/surprise-ai-pioneers-win-physics-nobel). Fascinante, pero intimidante a la vez ¿no lo crees?

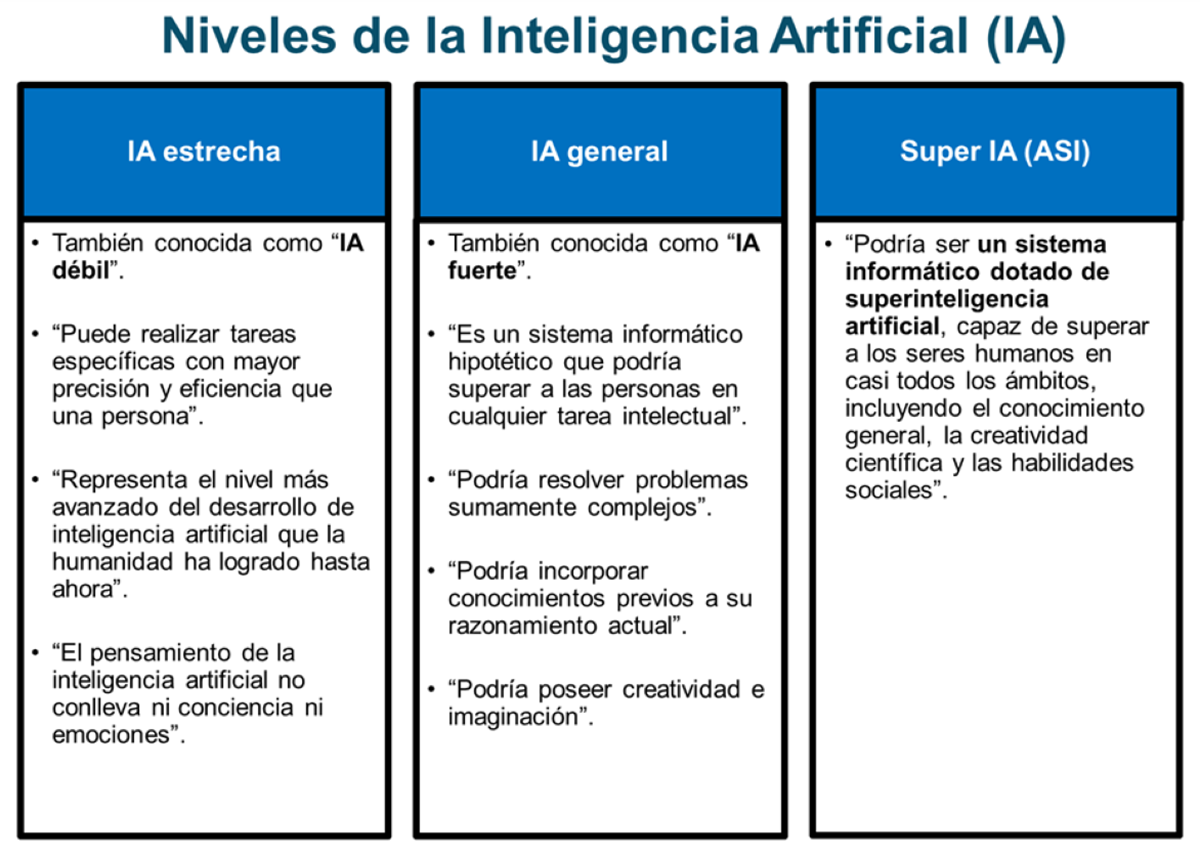

Pero ¿qué debemos entender por IA? De entrada, y analizando el fenómeno desde una perspectiva histórica, todo comenzó con la “IA estrecha”, que derivó en la “IA general” que a su vez derivó en la “Súper IA (ASI)” (entrecomillado por haber sido tomado literalmente de la fuente https://azure.microsoft.com/es-es/overview/what-is-artificial-intelligence/#how). Basándonos en esta misma fuente y parafraseando/resumiendo varias partes (y por ello el uso de texto entrecomillado para evitar incurrir en plagio), armamos el siguiente cuadro sinóptico para facilitarle el proceso de comprensión del proceso a la/el lectora/lector.

Dentro de la IA se manejan tres áreas: la IA, el “aprendizaje automatizado” (“machine learning” en inglés [https://www.bbva.com/es/innovacion/machine-learning-que-es-y-como-funciona/]) y el “aprendizaje profundo” (“deep learning” en inglés [https://www.ibm.com/es-es/topics/deep-learning]). En el caso del “aprendizaje automatizado”, lo que se busca es que las máquinas aprendan solas, sin necesidad de ser “expresamente programadas”. El “deep learning” se ha desarrollado usando las complejas redes neuronales de los humanos y otros organismos.

https://azure.microsoft.com/es-es/overview/what-is-artificial-intelligence/#how

Veamos primero el lado positivo de la IA. En parte gracias a la misma, los ganadores del Premio Nobel de Química pudieron comprender mucho mejor las estructuras de las proteínas y esbozar/diseñar potenciales nuevos medicamentos con la posibilidad de aplicarlos en la búsqueda de nuevos tratamientos para enfermedades hasta ahora incurables. En lenguaje muy sencillo y corriendo el riesgo de simplificar demasiado algo que en realidad es muy complejo, se intenta “funcionalizar” nuevas proteínas para que puedan cumplir tareas específicas que el científico o tecnólogo desea, con el fin de contribuir a la cura de enfermedades o aminorar el efecto de defectos genéticos en ciertas personas. Otro gran avance que la IA nos ha traído son los mecanismos de reconocimiento facial que usamos, por ejemplo, en nuestros teléfonos para hacer más seguro el acceso a la banca en línea o evitar el uso desmedido de códigos de acceso que si no los apuntamos, los olvidamos, o si lo hacemos, corremos el riesgo de que alguien ajeno los descubra y use para dañarnos. También se han desarrollado “chat bots”, programas de traducción en tiempo real (e.g., Google Lens), vehículos autónomos, implantes de chips inteligentes en el cerebro de personas con severas discapacidades (e.g., empresa Neuralink de Elon Musk), desarrollo de robots “humanoides” muy sofisticados (https://www.youtube.com/watch?v=I_TgZf7Lx24), mecanismos que permiten detectar primeros indicios de cáncer de mama incrementando exponencialmente la posibilidad de tratamientos oportunos (https://www.nationalgeographicla.com/ciencia/2023/04/un-metodo-basado-en-inteligencia-artificial-detecta-el-cancer-del-futuro), o como ya mencionamos antes, para la creación de nuevas proteínas o moléculas diversas útiles en la creación de nuevos fármacos(https://www.fundacionbankinter.org/noticias/ia-y-la-quimica-crean-nuevas-moleculas/?_adin=01225447001). Además, la IA se ha combinado con la computación cuántica, lo que ha permitido facilitar la simulación de las interacciones moleculares, y a su vez, pronosticar la eficiencia de dichas moléculas o compuestos desarrollados que serán utilizados en el tratamiento de enfermedades que son difíciles de curar (e.g., estas simulaciones pueden utilizarse para diseñar anticuerpos personalizados que son empleados para el desarrollo de inmunoterapias para combatir el cáncer) (https://vinculotic.com/salud/computacion-cuantica-en-medicina/; https://research.ibm.com/publications/combining-molecular-simulation-and-ai-for-antibody-design-against-cancer-immunotherapy-targets).

Estos son solo algunos ejemplos, de literalmente decenas que podríamos citar, pero que esperamos despierten tu interés por investigar por tu cuenta sobre los enormes beneficios que la IA nos traerá si la usamos de manera juiciosa y se adoptan medidas para evitar/controlar los riesgos que una herramienta tan poderosa lleva implícitos.

Entre los riesgos, en el sitio web (https://www.isdi.education) se manejan por ejemplo el “desplazamiento de empleos, sesgos algorítmicos, falta de empatía, menor privacidad, dependencia tecnológica, desafíos éticos, posibilidad de ataques cibernéticos y menor resolución de problemas inesperados” (se usan comillas por tratarse de una cita ad verbatim de lo que aparece en la liga antes proporcionada). Pero hay muchos más riesgos, por ejemplo, los potenciales efectos psicológicos (https://ndmarketingdigital.com/como-afecta-la-ia-en-la-salud-mental/; https://tuneuropsicologo.com/blog/el-impacto-de-la-inteligencia-artificial-en-nuestra-vida/), la clonación de voz y los fraudes que se pueden orquestar intimidando a familiares y amigos que caen en las trampas (https://expansion.mx/tecnologia/2023/05/25/riesgos-clonacion-de-voz-por-ia), creación de imágenes ficticias/falsas en artículos científicos (Gu et al. 2022) (aunque irónicamente la misma IA puede ser usada como herramienta para detectar este tipo de fraudes [Bao et al. 2022], usar ChatGPT para “escribir” artículos científicos o hacer las tareas encomendadas por profesores en cursos (AlAfnan et al. 2023; Barrot, 2023; Imran & Almusharraf, 2023; Sinclair, 2023), y para manipular la opinión de la sociedad mediante la creación de noticias falsas que se multiplican por millones. Sin embargo, lo que más intimida, es la pérdida de control cuando los algoritmos o robots toman vida propia y dejan de hacerle caso a sus creadores. Si se tratase de armas, aeronaves, autos automatizados (sin conductor), esto suena a ciencia ficción y al menos al ciudadano común, lo puede atemorizar mucho. El mayor temor lo genera el uso de la IA en conflictos bélicos o como “arma de guerra”, ya que podría literalmente implicar la extinción de Homo sapiens, irónicamente, el creador de esta herramienta (https://mitsloanreview.mx/destacado-home/la-inteligencia-artificial-como-arma-de-guerra/). Otro gran problema que está saliendo a la luz, es el elevadísimo costo ambiental que el uso de la IA provoca, ya que las supercomputadoras que se usan requieren de enormes espacios con aires acondicionados. Esto a llevado a muchas empresas, por ejemplo, en EUA, a presionar para que se construyan más plantas de generación de energía eléctrica mediante energía atómica, lo cual ha desatado mucha polémica.

Esperamos que, en este limitado espacio, hayamos logrado, por un lado, ayudarte a entender el vínculo de las personas galardonadas con los Premios Nobel de Física y Química con la IA. También para que estés mejor enterado de los enormes beneficios que la AI puede proporcionarnos en el ámbito de, por ejemplo, la medicina humana. Igualmente, para alertarte sobre lo potenciales riesgos del uso sin control de la IA, o si los robots creados con esta herramienta toman vida propia y ya no responden a los comandos de sus creadores. Esto último realmente asusta. Como todo en este mundo, los desarrollos tecnológicos tienen sus lados positivos y sus lados negativos, y lo más sano para el ciudadano común, es enterarse de estas dos facetas. Como mencionamos antes, hacemos votos para que este artículo te motive a seguir investigando sobre la IA …

Agradecimientos. Los autores agradecen al Instituto de Ecología, A.C. por las facilidades otorgadas para escribir este artículo siendo empleados de esta institución.

Referencias

- Al Afnan, M. A., Dishari, S., Jovic, M. & Lomidze, K. 2023. Chatgpt as an educational tool: Opportunities, challenges, and recommendations for communication, business writing, and composition courses. Journal of Artificial Intelligence and Technology 3: 60-68. https://doi.org/10.37965/jait.2023.0184

- Bao, Y., Hilary, G., & Ke, B. 2022. Artificial intelligence and fraud detection. In: Innovative Technology at the Interface of Finance and Operations (Babich, V., Birge J. R. & G. Hilary eds.). Springer. pp. 223-247. https://doi.org/10.1007/978-3-030-75729-8_8

- Barrot, J. S. 2023. Using ChatGPT for second language writing: Pitfalls and potentials. Assessing Writing 57: 100745. https://doi.org/10.1016/j.asw.2023.100745

- Gu, J., Wang, X., Li, C., Zhao, J., Fu, W., Liang, G., & Qiu, J. 2022. AI-enabled image fraud in scientific publications. Patterns 3: 1-6. https://doi.org/10.1016/j.patter.2022.100511

- Imran, M., & Almusharraf, N. 2023. Analyzing the role of ChatGPT as a writing assistant at higher education level: A systematic review of the literature. Contemporary Educational Technolog, 15: ep464. https://doi.org/10.30935/cedtech/13605

- Sinclair, B. J. 2023. Letting ChatGPT do your science is fraudulent (and a bad idea), but AI-generated text can enhance inclusiveness in publishing. Current Research in Insect Science 3: 100057. https://doi.org/10.1016/j.cris.2023.100057

La opinión es responsabilidad de los autores y no representa una postura institucional

Instituto de Ecología, A.C. – INECOL

1 autor para correspondencia -